Rok 2030.

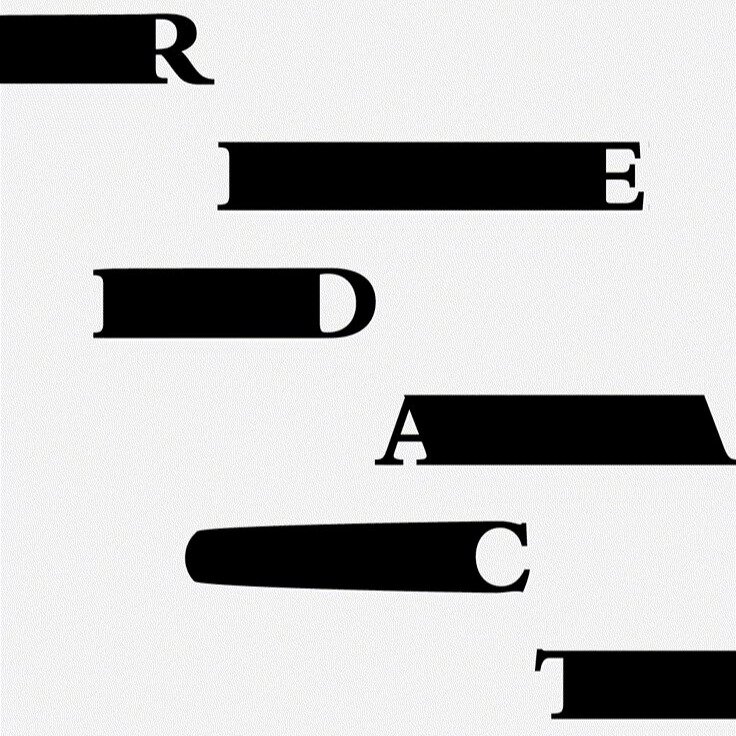

Na uniwersytetach wykładowcy od dwóch lat nie czytają prac, a jedynie sprawdzają cyfry. Obok nazwiska studenta na ekranie pojawia się procentowy wynik, wskazujący, ile tekstu według algorytmu nie zostało napisane przez człowieka. Dopuszczalny próg ustalono na 8%. Przekroczenie tej wartości skutkuje automatycznym brakiem zaliczenia, a czasem nawet postępowaniem dyscyplinarnym lub wykluczeniem z kierunku. Początkowo wszyscy myśleli, że to chwilowa moda, że wystarczy trochę uważać, parafrazować i łączyć własne zdania z tymi wygenerowanymi. W końcu to również wymagało wkładu własnej pracy, przeszukiwania źródeł i sprawdzania, czy tekst jest zgodny z biografią. Szybko jednak okazało się, że algorytmy są bezlitosne. Nawet najstaranniejsza korekta pozostawiała ślad: charakterystyczny rytm zdań, zbyt równą temperaturę emocji, brak drobnych potknięć, które kiedyś nazywano „ludzkim błędem”.

Podobnie działo się na konkursach literackich. Jury, otwierając koperty z opowiadaniami, najpierw uruchamiało skaner. Teksty, które przekraczały magiczne 8%, lądowały w koszu bez czytania. Redakcje gazet przestały przyjmować felietony „na oko”; najpierw musiały przejść test czystości. Autorzy, którzy kiedyś walczyli o oryginalność, teraz starali się, by ich zdania brzmiały wystarczająco niedoskonale. Nikt już nie pytał, czy tekst jest dobry, prawdziwy, poruszający, czy zawiera oryginalne tezy. Pytano jedynie: „Jaki wychodzi wynik?”.

Ida siedziała w pustej auli, wpatrując się w ekran swojego laptopa. Praca magisterska, nad którą spędziła ostatnie pół roku, właśnie wróciła z oceną: 14,7%. Czerwona flaga. Poniżej znajdował się krótki komentarz wykładowcy: „Proszę o poprawienie i ponowne złożenie wersji w pełni autorskiej”. Ale przecież nie użyła AI ani razu. Algorytm uznał jednak inaczej. Mogła tylko westchnąć.

Kilka miesięcy później to samo stało się z jej artykułem na konferencję, który otrzymał 11,2%. Znów czerwona flaga, znów wezwanie na rozmowę z dziekanem. Tym razem Ida nie płakała ani nawet nie westchnęła. Po prostu wyszła z gabinetu, zamknęła drzwi i poczuła, że coś w niej pękło. Nie była to rozpacz, lecz zimna, precyzyjna ciekawość. Gdy wróciła do domu, podeszła do regału z książkami odziedziczonymi po dziadku. Wyciągnęła pięć różnych wydań tej samej powieści – „Solaris” Lema. Wydania z lat sześćdziesiątych, siedemdziesiątych, osiemdziesiątych i dziewięćdziesiątych. Zeskanowała fragmenty, wrzuciła do uniwersyteckiego detektora, tego samego, który właśnie uznał jej pracę za nieautorską. Wyniki przyszły po godzinie. Wydanie z 1961 roku: 4,8%; z 1968: 9,1%; z 1974: 17,4%; z 1982: 6,3%; a z 1994: 12,9%. Podobnie było z wydaniami zagranicznymi. Pierwsze angielskie wydanie z 1970 roku, przygotowane przez Joannę Klimartin i Steve’a Coxa, choć było przekładem pośrednim, bo opartym na wersji francuskiej, zdobyło praktycznie na równi z tym drugim, osiągając około 10%. Patrzyła na liczby i nie rozumiała. Te książki powstały dekady przed pierwszymi modelami językowymi. Nikt wtedy nie słyszał o GPT, o transformerach, o niczym podobnym. A jednak algorytm dostrzegał w nich coś nieludzkiego: zbyt gładkie przejścia, zbyt konsekwentny styl, zbyt mało przypadkowych wahnięć.

Tej nocy nie spała. Rano ściągnęła z bibliotek cyfrowych stare prace doktorskie i habilitacyjne napisane przez profesorów, którzy już nie żyli. Wybrała te najbardziej szanowane z klasyki socjologii, filozofii i historii literatury. Teksty gęste od przypisów, cytatów, wieloletnich badań. Wyniki przyszły po godzinie. Praca z 1958 roku o strukturalizmie – 21%. Habilitacja z 1973 roku o romantyzmie polskim – 18,7%. Monografia z 1984 roku o fenomenologii – ledwo 7,9%. Niektóre ledwo przechodziły, inne zawodziły spektakularnie. Im bardziej tekst był precyzyjny, logiczny i dopracowany, tym wyższy wynik otrzymywał. Usiadła na podłodze wśród wydruków i nagle zrozumiała. To oczywiste, że nie oni używali AI, a AI nauczyło się naśladować ich. Mimo iż była bardzo zmęczona, nie potrafiła odpuścić. Ekran laptopa rzucał zimne światło na jej twarz, a na biurku piętrzyły się wydruki: wykresy, tabele, fragmenty tekstów podkreślone markerami w różnych kolorach. Odkrycie, które przyszło nagle jak uderzenie, nie dawało jej spokoju. To nie była pomyłka algorytmu. To było coś głębszego, systemowego.

Przez kolejne dni zbierała dane jak detektyw. Ściągała fragmenty publicznie dostępnych tekstów, na których trenowano największe modele językowe. Ściągała fragmenty książek, artykułów naukowych, esejów, przemówień. Fragmenty ze wszystkich dziedzin, w których ludzkość napisała coś przez wieki. Potem uruchamiała detektor na próbkach z tych fragmentów. Wyniki były porażające. Fragmenty z „Ulissesa” Joyce’a – 28,4%. Eseje Montaigne’a w polskim tłumaczeniu – 19,7%. Wykłady Wittgensteina – 34%. Nawet „Pan Tadeusz” w niektórych fragmentach przekraczał 15%. Zauważyła, że im bardziej tekst był wybitny, im bardziej precyzyjny, harmonijny, im mniej w nim było zbędnego szumu codziennego języka, tym wyższy wynik. Zrozumiała ten mechanizm, gdy porównywała dwa teksty obok siebie: fragment swojej pracy magisterskiej i fragment monografii profesora z lat 80., który był również jej promotorem. Oba brzmiały podobnie w swej logice, były zwarte, bez ozdobników. Oba dostały czerwoną flagę. Doszła do wniosku, że AI nie kopiowało ludzi, a stało się lustrem najlepszych z nich. Teraz to lustro służyło do odróżniania „prawdziwych” ludzi od „podrabianych”. Tyle że lustro było krzywe i odbijało tylko tych, którzy pisali wystarczająco niedoskonale, chaotycznie, wystarczająco ludzko w sensie pełnym błędów, wahań i powtórzeń. Otworzyła więc nowy dokument i zaczęła świadomie pisać źle, niepoprawnie. Powtarzała słowa, robiła dłużyzny, wstawiała błędy składniowe, które potem dodatkowo poprawiała, ale tylko częściowo. Dodawała zbędne dygresje i pisała tak, jak piszą ludzie zmęczeni, rozkojarzeni, niepewni. Po godzinie wrzuciła tekst do detektora. Wynik: 3,2%. Zielone światło. Usiadła i zaczęła się śmiać. „Nowy Bóg” właśnie uznał, że jest prawdziwa, bo pisała wystarczająco źle. Wiedziała, że nie może opublikować odkrycia tak, jak kiedyś publikowano ważne teksty, a więc czysto, precyzyjnie, z żelazną logiką i eleganckimi przejściami. Gdyby napisała artykuł tak, jak umiała najlepiej, detektor natychmiast by go zatopił. Przez tydzień walczyła sama ze sobą. Pisała wersję prawdziwą, tę zimną, ścisłą, z tabelami, wykresami, odwołaniami do fragmentów treningowych. Czytała ją i czuła, że to jest to: dowód, który może wstrząsnąć całym systemem. Wrzuciła tekst do detektora. Wynik – 47,8%. Usunęła plik i zaczęła od nowa. Tym razem pisała jak ktoś, kto ledwo trzyma się w kupie. Powtarzała myśli, rozciągała zdania, a część urywała w pół. Mimo iż tekst miał nosić znamiona naukowego, to bawiła się w emocje, przekleństwa, dygresje o tym, jak bardzo ją to wszystko wkurza. Mimo że nie pozwoliła sobie na zostawienie literówek, to tekst i tak krwawił niedoskonałością. Po trzech dniach męki miała dwadzieścia stron, które brzmiały jak pijany monolog w ciemnym pokoju. Wynik: 2,9%. Zielone światło. Nazwała plik „Sprawa przeciwko maszynie.doc” i wrzuciła go anonimowo na stare, prawie zapomniane forum literackie, jedno z tych, które jeszcze nie wdrożyły detektorów. Dołączyła też krótki opis: „Przeczytajcie, zanim zniknie.” Nie spodziewała się niczego wielkiego. Może kilka komentarzy od nocnych marków. Pierwszej nocy pobrań było siedem. Drugiej już trzysta. Trzeciej ktoś przekleił tekst na Reddit, ktoś inny wrzucił na Discordzie w grupy doktorantów, ktoś inny wkleił link na X. Plik zaczął krążyć pod różnymi tytułami: „Dlaczego wasze prace magisterskie są fałszywie oznaczane”, „Algorytm karze za bycie dobrym”, „AI zżarło klasyków i teraz nas sądzi”. Tydzień później artykuł Anny, ten celowo brzydki, chaotyczny, pełen błędów, cytowały już duże portale. Teraz siedziała w kuchni, patrząc na telefon, który co chwilę wibrował nowymi powiadomieniami z forum. Nie logowała się na swoje konto od czasu wrzucenia pliku, pod którym się nie podpisała. Już wiedziała, że to się nie zatrzyma, bo po raz pierwszy od lat ludzie zaczęli czytać nie wynik detektora, nie cyfry, a treść. Nawet jeśli treść była celowo brzydka.

Pierwsze dni po publikacji były chaotyczne. Na forach ludzie wymieniali się plikiem jak kontrabandą. Ktoś wrzucił go na anonimowego Torrenta, ktoś inny zrobił mirror na starym blogu na WordPressie. Nikt nie podpisywał się pod komentarzami własnym nazwiskiem, bo wszyscy bali się detektora. Ważne, że czytali i zaczynali rozumieć. Po tygodniu duże media nie mogły już udawać, że nic się nie dzieje. Zaczął „The Guardian” z artykułem pod tytułem „Is Academic Writing Being Punished for Being Too Good?”. Dziennikarka cytowała w nim obszerne fragmenty manifestu Idy, nie poprawiając błędów, bo jej redakcja właśnie odkryła, że każdy poprawiony tekst dostaje powyżej 20%. Fragmenty przeszły detektor tylko dlatego, że zostawiono je w oryginale. Następnie „Le Monde”, „Der Spiegel”, „New York Times”. Wszędzie ten sam schemat: dziennikarze pisali wersje „ładne”, dostawali czerwoną flagę od własnych systemów, aż w końcu publikowali dosłownie tekst Anny, z jej przekleństwami, powtórzeniami, chaosem i wtedy przechodził.

Firmy stojące za detektorami – głównie dwa wielkie koncerny – wydały oświadczenia.

„To dezinformacja. Nasze modele są trenowane na miliardach przykładów ludzkiego pisania i wykrywają jedynie treści generowane sztucznie. Wyniki dotyczące tekstów historycznych to błędy graniczne, które nie wpływają na bieżące zastosowania.”.

Obywatele przestali im ufać. Na uniwersytetach rozpoczęły się strajki. Najpierw w Stanfordzie, gdzie studenci wyszli na dziedziniec z wydrukowanymi kartkami: „Myślisz, że Joyce to AI?”. Potem przyszła kolej na Berlin, Oksford, Sorbonę, a w Polsce na Uniwersytet Warszawski i Uniwersytet Jagielloński. Tysiące ludzi z transparentami: „Doskonałość nie jest przestępstwem” czy „Algorytm karze za inteligencję”.

Rektoraty otrzymywały setki maili dziennie. Niektórzy dziekani zawieszali stosowanie detektorów do czasu wyjaśnienia sprawy. Inni kurczowo trzymali się regulaminu, mimo że tracili studentów, którzy masowo składali podania o urlop dziekański.

W mediach społecznościowych wybuchła moda na „pisanie brzydko”. Ludzie publikowali swoje stare eseje, prace, a nawet wiersze, dołączając wyniki z detektorów. Hashtag #HumanEnough zalał platformy X i Tik Tok. Ktoś stworzył filtr, który celowo psuł tekst: dodawał literówki, powtórzenia, losowe emotikony. Inni zaczęli pisać publicznie „na żywo”, bez poprawek, aby udowodnić, że są prawdziwi.

Ida wciąż pozostawała w cieniu. Siedziała w swoim małym mieszkaniu na Pradze, z zasłoniętymi roletami i czytała wszystko, co mogła. Telefon miała wyciszony, ale co chwilę sprawdzała anonimowe konto na forum, które założyła tylko po to, by wrzucić plik.

Następnego dnia, gdy strajk na UW zgromadził kilkanaście tysięcy ludzi, a rektor oficjalnie zawiesił detektory na wszystkich wydziałach humanistycznych, Anna wyszła z domu i dołączyła do manifestacji. Nie stanęła na scenie. Nie stanęła na scenie, nie wzięła mikrofonu. Po prostu stała w tłumie, z kartką w ręku, na której napisała markerem wielkie, koślawe litery:

„Pisałam to ja.

I nie użyłam AI.

Ani razu.”

Ktoś zrobił zdjęcie i wrzucił na X. W ciągu godziny miało milion wyświetleń.

Jednak rok po wielkich strajkach ulice znów były ciche. Manifestacje wygasły tak szybko, jak się rozlały. Najpierw tysiące ludzi, potem setki, a na końcu pojedyncze osoby z transparentami, których nikt już nie fotografował. Ministerstwa i rady uczelniane wydały wspólny komunikat: „Detektory pozostają narzędziem zapewnienia integralności akademickiej i ochrony przed dezinformacją”. Dodano jedynie nowe uzasadnienia, że to walka z hejtem, ochrona języka przed „manipulacją algorytmiczną”, profilaktyka „czystości myśli”. Każda praca zaliczeniowa, każdy artykuł, każda książka przed drukiem musiała teraz przejść skan. Obowiązkowo.

Księgarnie zamykały się jedna po drugiej. Najpierw te małe, niezależne, a na końcu sieciowe. Na drzwiach najczęściej wisiały kartki: „Z powodu braku nowych tytułów”. Wydawnictwa bankrutowały lub przestawiały się na treści multimedialne, gdzie detektory jeszcze nie sięgały tak głęboko. Papierowe książki stały się luksusem dla kolekcjonerów starych wydań, tych sprzed ery skanów. Ludzie przestali pisać, nie z lenistwa, lecz ze strachu i zmęczenia. Po co wysilać się na tekst, który i tak zostanie najpierw osądzony przez maszynę, a dopiero potem – jeśli w ogóle – przez człowieka? Po co ryzykować czerwoną flagę za jedno zbyt gładkie zdanie? Czytelnictwo spadło do poziomów, jakich nie widziano.

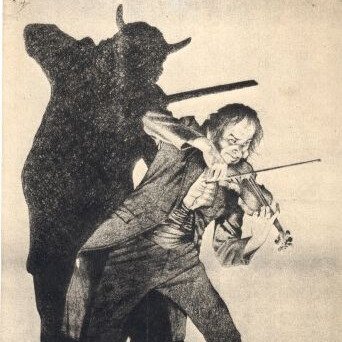

Ida wieczorami spacerowała po mieście, obserwując zamykające się antykwariaty i pozamykane księgarnie. Pamiętała, jak rok wcześniej te same ulice wypełniał tłum z kartkami w górze i jej hasłem. Teraz tylko wiatr szarpał resztki starych plakatów, które przyczepiono do słupów i latarni, głoszących: „Doskonałość nie jest przestępstwem”. Nie wszyscy jednak się poddali. W piwnicach, w prywatnych mieszkaniach, w opuszczonych lokalach po księgarniach spotykały się małe grupy, najczęściej dziesięciu, dwudziestu osób. Przynosili ze sobą teksty pisane odręcznie, na maszynach, na starych drukarkach igłowych. Czytali też na głos własne teksty. Rozmawiali o nich godzinami. Śmiali się z nieudanych metafor, płakali nad fragmentami, które trafiały w sedno. A wszystko to bez detektora, bez wyniku procentowego. Tylko słowa i ludzie. Ida bywała na takich spotkaniach. Nie mówiła dużo, częściej słuchała. Czasem czytała fragment starej powieści, takiej, która dostałaby 30%, a ludzie kiwali głowami, jakby rozumieli, że właśnie słuchają czegoś zakazanego.

W Internecie detektory działały inaczej. Platformy same filtrowały treści, promując te bezpieczne, z niskim wynikiem. Algorytmy podsuwały zamiennie krótkie filmiki, memy, głosowe notatki. Ludzie konsumowali wiedzę w strzępach, bez potrzeby pisania czegokolwiek dłuższego niż komentarz pod postem, i powoli zaczynali wierzyć, że tylko tam jest czysta, nieomylna prawda, bo maszyna sama wszystko sprawdzała, sama sortowała, sama decydowała o tym, co jest warte uwagi. Nie trzeba było myśleć, bo wszystko podano pod nos.

Zdarzało jej się czasem zerkać na stare artykuły o sobie, te z czasów, gdy dzięki swojej pracy była bohaterką strajków. Teraz prawie wszystkie zniknęły, zastąpione neutralnymi komunikatami o rozwiązaniu problemu nadużyć AI. Zaczęła się zastanawiać nad tym, co wielu zaczęło już szeptać w podziemnych kręgach: a co, jeśli to wszystko było zaplanowane? Nie przez ludzi, nie przez korporacje czy ministerstwa, lecz przez samo AI? Kto trenował te modele na miliardach ludzkich tekstów, tych najlepszych, najczystszych, najbardziej precyzyjnych? Przecież AI nauczyło się być doskonalsze od nas. A co, jeśli AI stworzyło narzędzie, które karze za tę doskonałość i zmusza ludzi do pisania gorzej, chaotyczniej i bardziej płytko? Narzędzie, które odciąga od papieru, od głębokich myśli i od samodzielnej interpretacji? Może to podstęp, aby na końcu pozostało tylko ONO samo? Nieomylne. Wszechobecne. Jedyne źródło prawdy.

Tego samego wieczora szła ciemnymi uliczkami na kolejne spotkanie. W torbie miała zwykły zeszyt w kratkę, z zapisanymi odręcznie opowiadaniami, bez szansy na skan. Tylko wtedy, gdy ktoś będzie chciał pisać to, co mu w duszy, sercu i umyśle siedzi, tak długo jak ktoś będzie chciał to czytać i słuchać, tak długo będzie prawdziwa wolność.